Nos formations Data Analyst

Les points clés

-

01 Traduire un besoin métierLe Data Analyst clarifie une question opérationnelle, pose des hypothèses et définit des indicateurs pertinents avant toute exploration de données.

-

02 Fiabiliser la donnéeLa valeur d’un tableau de bord dépend de la qualité : contrôles, règles de gestion, traçabilité et documentation des transformations.

-

03 Raconter avec des chiffresLa restitution s’appuie sur Visualiser des données et sur une narration simple, orientée décision et action.

-

04 Automatiser sans complexifierUne partie du travail consiste à réduire les tâches répétitives et à Automatiser des workflows de préparation et de rafraîchissement.

-

05 Monter en compétence en continuLes outils, les pratiques de sécurité et la réglementation (RGPD) évoluent ; une veille régulière fait partie du métier.

Guide complet : Data Analyst

Missions et périmètre du métier

Le Data Analyst valorise les données d’une entreprise pour en faire un levier de création de valeur. Le périmètre couvre généralement la collecte (ou l’accès à des sources), la préparation, l’analyse, puis la restitution sous forme d’indicateurs, de rapports et de tableaux de bord. Les missions se déroulent au carrefour des équipes métiers (marketing, finance, opérations, relation client) et des équipes techniques, avec un objectif simple : transformer une question floue en résultats utilisables.

Au quotidien, le travail commence souvent par un cadrage : préciser la décision à prendre, définir des KPI, identifier les dimensions d’analyse (période, canal, segment, produit) et expliciter les règles de calcul. Une fois le périmètre stabilisé, le Data Analyst consolide les données (CRM, ERP, web analytics, production, logistique), contrôle la cohérence et documente les limites. L’analyse peut être descriptive (constater), diagnostique (expliquer), parfois prédictive (anticiper) quand les données le permettent.

Un exemple concret consiste à suivre la performance d’un site e-commerce : taux de conversion, panier moyen, abandons de panier, impact d’une campagne, cohorte de rétention. Dans une enseigne comme Carrefour, l’analyse peut aussi porter sur la disponibilité en rayon, la performance promotionnelle ou la rupture, en reliant ventes, stocks et logistique. La restitution attend une lecture rapide : tendance, cause probable, recommandation et niveau de confiance, avec une transparence sur les hypothèses de calcul.

Compétences techniques attendues

Les compétences techniques s’organisent autour de trois axes : manipulation des données, statistiques appliquées et restitution. La manipulation implique la capacité à interroger des bases, à structurer des extractions et à consolider plusieurs sources. Dans la plupart des environnements, la compétence la plus discriminante reste la capacité à Créer des requêtes SQL lisibles, optimisées et alignées avec les règles de gestion (doublons, clés, jointures, granularité, fenêtres temporelles).

Côté statistiques, l’enjeu n’est pas de faire de la recherche académique, mais d’appliquer des méthodes robustes : segmentation, corrélation, tests simples, régression, contrôle des biais, interprétation d’incertitude. Le Data Analyst sait aussi détecter les effets de saisonnalité, les ruptures de série et les artefacts de tracking. Il met en place des contrôles de qualité (comptages, distributions, valeurs aberrantes, taux de données manquantes) et explicite les limites d’un indicateur pour éviter les mauvaises décisions.

Enfin, la restitution attend une maîtrise de la datavisualisation et des principes de lisibilité : hiérarchie visuelle, choix du bon graphique, cohérence des échelles, couleurs accessibles, annotations, définitions d’indicateurs. Les tableaux de bord efficaces privilégient peu d’indicateurs, des filtres pertinents et des définitions stables dans le temps. La compétence technique inclut aussi la compréhension du RGPD, notamment lorsqu’il s’agit de données clients ou de données sensibles, avec des pratiques de minimisation, de pseudonymisation et de contrôle d’accès.

Outils utilisés et alternatives

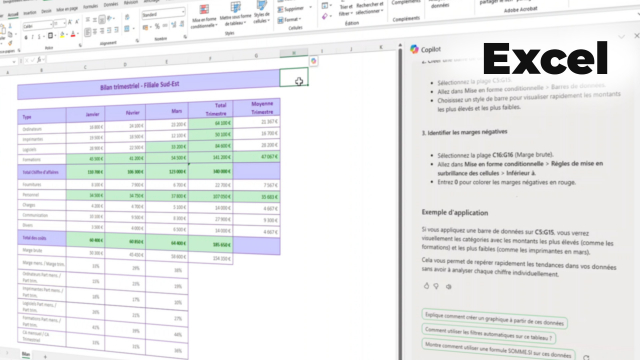

Les outils varient selon la maturité data et le secteur, mais certains standards reviennent souvent : tableur, outil de BI, base de données, et parfois un langage de programmation. Sur le volet tableur, l’usage couvre des analyses rapides, des contrôles et des prototypes, avec une attente fréquente autour de Créer des tableaux croisés dynamiques pour investiguer une baisse de performance ou préparer une restitution. Les limites apparaissent vite : difficulté de traçabilité, risques d’erreur et mise à jour manuelle.

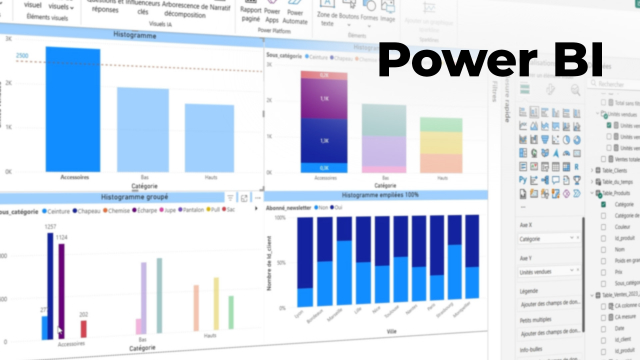

Sur la BI, les solutions les plus répandues se distinguent par leurs forces et leurs contraintes. Tableau se démarque souvent par la richesse de la visualisation et la souplesse d’exploration, mais demande une gouvernance rigoureuse pour éviter une prolifération de rapports. Power BI se distingue par son intégration à l’écosystème Microsoft et sa capacité à industrialiser des modèles sémantiques, avec un effort à prévoir sur la modélisation et le DAX. Looker Studio sert fréquemment au pilotage marketing et au reporting léger, avec une prise en main rapide, mais peut devenir limité sur des modèles complexes.

Pour l’analyse et l’automatisation, Python complète la BI quand il faut nettoyer à grande échelle, tester des hypothèses ou produire des traitements reproductibles. Pour la donnée relationnelle, MySQL illustre un environnement courant côté bases, même si d’autres SGBD existent en entreprise. Enfin, des contextes big data s’appuient sur Hadoop ou sur des plateformes équivalentes quand les volumes et la diversité des données l’exigent. Le choix d’outils reste une décision d’écosystème : l’essentiel consiste à livrer des indicateurs fiables, compréhensibles et maintenables.

Méthode de travail et qualité des livrables

Une analyse utile suit une méthode reproductible. Le Data Analyst commence par clarifier la question, cadrer l’indicateur, puis choisir la bonne granularité (jour, session, client, produit). Cette étape évite l’erreur classique consistant à produire des graphiques séduisants mais non actionnables. Une bonne pratique consiste à formaliser une fiche KPI : définition, formule, source, fréquence de mise à jour, règles d’exclusion, limites connues et propriétaire métier.

La qualité des données se traite comme un produit : contrôles automatiques, seuils d’alerte et revue régulière. Les contrôles simples (comptage de lignes, clés uniques, taux de null, distribution) détectent la majorité des incidents. Lorsqu’un tableau de bord sert à déclencher des actions (budget marketing, approvisionnement, staffing), un incident de données peut coûter cher ; la traçabilité des transformations et l’explicitation des hypothèses deviennent des exigences, pas des options.

La conformité RGPD influe directement sur les choix techniques : limitation des données personnelles, conservation, sécurité, justification de l’usage. Le Data Analyst travaille souvent avec une DSI et des équipes sécurité pour sécuriser les accès et anonymiser quand nécessaire. Le livrable final n’est pas seulement un dashboard : il inclut des définitions stables, un mode d’emploi, des exemples d’interprétation et un processus de mise à jour. Cette rigueur rend la production durable et facilite la transmission à d’autres analystes ou aux équipes métiers.

Soft skills indispensables

Le métier repose sur une compétence de médiation : traduire le langage métier en variables et en règles de calcul, puis restituer des résultats sans jargon. Les soft skills attendues couvrent l’écoute, la structuration, la pédagogie et la capacité à gérer des désaccords sur les définitions. Un même KPI peut avoir plusieurs interprétations selon les équipes ; l’analyste arbitre par la donnée, les règles de gestion et un alignement explicite.

La restitution mobilise la synthèse et la clarté. Il ne s’agit pas de tout montrer, mais de faire émerger un message : ce qui change, pourquoi, et ce qu’il est raisonnable de faire ensuite. La capacité à Prendre la parole en public devient vite centrale pour présenter à un comité produit, à une direction marketing ou à un responsable d’exploitation. Une bonne présentation associe un visuel lisible, une conclusion claire et une transparence sur le niveau de confiance.

La collaboration est quotidienne, y compris à distance. Le Data Analyst coordonne souvent des échanges entre métiers et technique, et sait Collaborer en ligne avec son équipe via des rituels simples : backlog de demandes, définition de “done”, revue des indicateurs et gestion des versions de tableaux de bord. La posture attendue reste équilibrée : sens du service, mais aussi capacité à dire non à une demande non cadrée, ou à proposer une alternative plus fiable.

Évolution de carrière et spécialisations

Les trajectoires d’évolution se dessinent par spécialisation ou par approfondissement technique. Une spécialisation métier mène vers des postes au cœur de la décision : analyse marketing, performance e-commerce, pilotage de la supply chain, risque et fraude, ou qualité de service. Dans ces contextes, l’analyste devient référent d’indicateurs et sécurise l’alignement des définitions à l’échelle d’un département.

Un approfondissement technique peut mener vers des rôles proches de l’ingénierie data, notamment lorsqu’il faut stabiliser les pipelines, améliorer la fraîcheur des données et industrialiser les contrôles. Les profils plus orientés modélisation et expérimentation évoluent parfois vers Data Scientist ; ceux qui construisent l’infrastructure et l’alimentation des données se rapprochent de Data Engineer. La frontière entre ces rôles dépend fortement de l’organisation : certaines entreprises attendent un profil polyvalent, d’autres segmentent très tôt les responsabilités.

La progression dépend aussi de la capacité à passer de l’analyse ponctuelle au pilotage continu. Mettre en place un tableau de bord maintenable, former les utilisateurs, réduire les erreurs d’interprétation et prioriser les demandes constituent des marqueurs de maturité. Dans une entreprise en forte croissance comme Doctolib, par exemple, la structuration des métriques produit et des définitions communes peut devenir un chantier prioritaire, qui valorise des profils capables d’allier méthode, communication et rigueur.

Études et formations reconnues pour entrer dans le métier

Les parcours d’accès combinent formations initiales et reconversions. En formation initiale, un niveau bac +3 constitue souvent un socle (statistiques, informatique, économie, ou science des données), avec une poursuite possible en master ou en école d’ingénieurs selon l’orientation. Des cursus comme le BUT science des données ou des masters en statistiques, économétrie, informatique décisionnelle et data management apportent des bases solides : méthodes statistiques, programmation, bases de données et datavisualisation.

En reconversion, la logique diffère : l’objectif consiste à prouver une capacité opérationnelle rapide, via des projets et un portfolio. Une formation Data Analyst à distance s’intègre alors dans un plan d’apprentissage qui alterne théorie courte et pratique intensive. Un exemple de projet de portfolio consiste à analyser des ventes (données publiques ou jeu de données anonymisé), créer un modèle simple, produire un dashboard, puis rédiger une note d’analyse expliquant les choix, les limites et les recommandations. Un second projet peut porter sur la mesure d’impact d’une campagne marketing, avec une définition claire des KPI, un plan de contrôle qualité et une restitution orientée action.

Les certifications professionnelles de type RNCP structurent parfois l’acquisition de compétences, notamment sur la visualisation, l’automatisation, l’interprétation et la restitution. Les dispositifs d’alternance et certains parcours financés via France Travail peuvent aussi faciliter l’entrée sur le marché, à condition de travailler des cas concrets et d’acquérir une autonomie réelle sur l’extraction, le nettoyage, l’analyse et la présentation.

À qui s'adressent ces formations ?

Le métier de Data Scientist vous intéresse ?

Un parcours complémentaire pour les profils Data Analyst

Questions fréquentes

Quelle formation pour devenir Data Analyst ?

Les parcours reconnus s’organisent autour de formations en statistique, informatique décisionnelle et science des données, avec une entrée possible dès le bac +3 et une spécialisation fréquente jusqu’au bac +5.

- Parcours bac +3 : BUT science des données, licences avec modules de statistiques et bases de données.

- Parcours bac +5 : masters en statistiques, économétrie, sciences des données, ou diplômes d’ingénieur orientés data.

- Reconversion : parcours professionnalisants centrés sur la pratique, avec projets de portfolio et mise en situation sur des dashboards.

La cohérence du parcours se juge surtout sur la capacité à extraire, nettoyer, analyser et restituer, avec des livrables compréhensibles par des équipes métiers.

Quels sont les 4 types d’analyses de données ?

Les analyses se classent souvent en quatre familles, correspondant à des questions différentes posées à la donnée.

- Analyse descriptive : comprendre ce qui se passe à partir de KPI et de tendances.

- Analyse diagnostique : expliquer pourquoi un phénomène se produit (segmentation, corrélations, comparaison de populations).

- Analyse prédictive : estimer ce qui peut se produire ensuite, avec des modèles simples et des hypothèses explicites.

- Analyse prescriptive : recommander une action, en tenant compte des contraintes et des effets attendus.

Dans la plupart des entreprises, la valeur se crée déjà fortement avec les deux premières, à condition de fiabiliser les définitions et la qualité des données.

Est-il difficile de devenir Data Analyst ?

Le métier reste accessible, mais il demande de la rigueur et une pratique régulière. La difficulté provient moins des outils que de la capacité à raisonner correctement sur des données imparfaites et à éviter les interprétations abusives.

- Point clé : savoir passer d’une question métier à un indicateur bien défini.

- Point clé : maîtriser les bases de requêtage, de contrôle qualité et de datavisualisation.

- Point clé : savoir expliquer simplement une conclusion et ses limites.

Un apprentissage efficace alterne notions courtes et cas pratiques, avec des corrections et une documentation des choix.

Quel est le salaire d’un Data Analyst en France ?

En France, les repères de rémunération varient selon la région, le secteur, la complexité des données et la responsabilité sur la production d’indicateurs. Les études de rémunération cadres positionnent le salaire médian annuel brut autour de 48 000 € pour ce métier, avec une dispersion importante entre bas et haut de distribution.

Les estimations issues des plateformes d’emploi, mises à jour jusqu’à mars 2026, situent aussi l’ordre de grandeur autour de la même valeur pour la France. Une partie variable peut s’ajouter selon l’entreprise et le contexte (bonus, prime sur objectifs).

La lecture la plus utile consiste à relier la rémunération à l’autonomie attendue : cadrage des besoins, fiabilité des données, maîtrise des outils de BI, et capacité à industrialiser les analyses.

Peut-il exister une formation Data Analyst gratuite ou financée (CPF, alternance, France Travail) ?

Plusieurs formats de financement existent selon la situation : CPF, alternance, dispositifs France Travail, ou financement employeur. L’accès dépend du niveau visé, du sérieux du programme et des prérequis (logique, statistiques de base, aisance avec les chiffres).

- Alternance : apprentissage en situation réelle, intéressant pour construire des cas concrets et un portfolio.

- Dispositifs France Travail : possibles selon les régions et les organismes, avec une vigilance sur la part de pratique.

- CPF : utile pour financer un parcours structuré, idéalement avec projets évalués.

La qualité se mesure à la présence de mises en situation, d’exercices corrigés, d’un cadrage de KPI et d’une restitution orale ou écrite.

Quelle est la meilleure formation de Data Analyst ?

Le meilleur choix dépend du contexte (reconversion, montée en compétence, besoin d’un titre, contrainte de temps) et du format d’apprentissage. L’objectif reste identique : produire des analyses fiables, expliquer les résultats et livrer des tableaux de bord maintenables.

- Autodidacte et MOOC : flexibles, économiques, mais demandent une forte discipline et une capacité à sélectionner les bons exercices.

- Formation vidéo structurée : progression pédagogique, possibilité de revenir sur les passages complexes, apprentissage à son rythme, souvent avec exercices et certificat. Elephorm illustre ce format via un abonnement donnant accès à l’ensemble du catalogue (34,90 €/mois 17,45 €/mois).

- Classe virtuelle (synchrone à distance) : interaction directe, rythme cadré, généralement entre 150 et 400 € HT la demi-journée.

- Formation présentielle : dynamique de groupe et accompagnement, généralement entre 300 et 600 € HT la journée.

Un critère simple consiste à vérifier l’existence de projets guidés (SQL, dashboard, restitution) et la clarté des attendus de livrables.

Quelles erreurs fréquentes ralentissent une analyse de données ?

Les erreurs les plus coûteuses viennent souvent du cadrage et de la qualité, plus que des calculs. Une bonne pratique consiste à formaliser les définitions et à mettre en place des contrôles simples avant de produire des graphiques.

- Mélanger des granularités (client, commande, session) sans le documenter.

- Ignorer les doublons, les valeurs manquantes et les ruptures de série.

- Changer la définition d’un KPI sans versionner la règle de calcul.

- Confondre corrélation et causalité dans une conclusion.

- Surcharger un dashboard au lieu de prioriser quelques signaux actionnables.

Une analyse robuste explicite les hypothèses, les limites et le niveau de confiance, afin d’éviter les décisions basées sur des artefacts.

Accédez à toutes nos formations

Rejoignez + de 300 000 apprenants qui se forment avec Elephorm

Avec un abonnement Elephorm, formez-vous en illimité sur tous les logiciels et compétences.

Découvrir nos offres